Punkt wyjścia: o co naprawdę chodzi w wyborze między TensorFlow a PyTorch

Większość osób szukających odpowiedzi na pytanie „TensorFlow czy PyTorch” liczy na prostą receptę: wybierz X, bo jest szybszy / nowocześniejszy / bardziej „production-ready”. Problem w tym, że takie zero-jedynkowe podejście zwykle prowadzi do rozczarowania po kilku miesiącach pracy nad prawdziwym systemem.

Zamiast pytać „który framework jest obiektywnie lepszy”, bardziej sensownie jest zapytać: który zestaw narzędzi najmniej utrudni utrzymanie i rozwój konkretnego projektu w ciągu najbliższych 12–24 miesięcy. To inna perspektywa niż „co jest modne na GitHubie” albo „czego używa ulubiony kurs online.

Framework do nauki a framework do stabilnej produkcji

TensorFlow i PyTorch świetnie sprawdzają się do nauki i prototypowania, ale produkcja dokłada zupełnie inne wymagania niż prosty notebook na GPU. Kiedy kod ma obsługiwać realny ruch, liczą się już nie tylko:

- jakość predykcji,

- łatwość pisania kodu,

- liczba gwiazdek na GitHubie,

ale także:

- czy framework dobrze współpracuje z narzędziami MLOps w firmie,

- jak trudno będzie wdrożyć kolejne wersje modelu,

- czy nowi członkowie zespołu ogarną kod bez tygodni wdrożenia,

- jak wygląda debugowanie problemów już po wypuszczeniu na produkcję.

Często jest tak, że framework, który „czuje się” lżejszy i bardziej elastyczny w fazie eksperymentów, wymaga dodatkowej pracy przy standaryzacji, eksportowaniu i serwowaniu modeli. I odwrotnie – środowisko, które jest nieco toporne na początku, może dawać dużo więcej „za darmo” na etapie skalowania produkcji.

Kontekst projektu: jednorazowy eksperyment czy produkt SaaS

Wybór między TensorFlow a PyTorch nabiera sensu dopiero wtedy, kiedy odpowiesz sobie na kilka prostych pytań o kontekst projektu. Zupełnie inaczej podejdziesz do decyzji, jeśli:

- robisz jednorazowy proof of concept dla klienta (liczy się szybkość i elastyczność),

- budujesz produkt SaaS, który będzie rozwijany latami (ważna jest przewidywalność, łatwe aktualizacje, monitoring),

- tworzysz system o krytycznym znaczeniu (finanse, medycyna, bezpieczeństwo), gdzie liczy się niezawodność, audytowalność i zgodność z regulacjami,

- masz do zintegrowania istniejącą infrastrukturę (np. cały ekosystem GCP albo AWS, już używane narzędzia CI/CD, monitoring).

Osoba pracująca w małym startupie, która sama odpowiada za kod, infrastrukturę i monitoring, potrzebuje innego „zestawu tarć” niż zespół w dużej organizacji, gdzie istnieje osobny dział platformowy i DevOps. W pierwszym przypadku prostota i szybkość iteracji mogą być ważniejsze niż „idealne” wpasowanie się w korporacyjny tech stack. W drugim – łatwość integracji z tym, co już stoi w produkcji, będzie często krytyczna.

Co jest naprawdę „na zawsze”, a co można zmienić później

Obawa, która paraliżuje sporo osób: „jeśli wybiorę nie ten framework, będę musiał(a) przepisać wszystko od zera”. Rzeczywistość jest mniej dramatyczna, ale warto odróżnić elementy decydujące długoterminowo od tych, które da się zmienić stosunkowo łatwo.

Do kategorii decyzji trudnych do zmiany należą zwykle:

- formaty modeli, w których trzymasz artefakty (SavedModel, TorchScript, ONNX),

- sposób serwowania (TensorFlow Serving, TorchServe, własne API z FastAPI/Flask, serwis na Kubernetesie),

- standardy zespołu: style kodowania, struktura repozytoriów, narzędzia do eksperymentów,

- proces MLOps: jak wersjonujesz modele, jak wygląda roll-back, jak robisz A/B testy.

Z kolei rzeczy łatwiejsze do zmiany w czasie to:

- konkretne implementacje modeli (architekturę często i tak refaktoryzujesz),

- biblioteki na poziomie wyższym (Lightning, Keras, FastAI),

- część narzędzi do eksperymentów (np. zamiana Weights&Biases na MLflow).

Framework bazowy (TensorFlow vs PyTorch) jest gdzieś pomiędzy: samą implementację modelu da się przeportować, zwłaszcza jeśli korzystasz z ONNX lub gotowych repozytoriów, ale im bardziej specyficzne narzędzia danego ekosystemu wykorzystujesz (np. komponenty TFX, customowe rozszerzenia C++), tym większy koszt zmiany później.

Jak oswoić lęk przed „złym wyborem”

Lęk przed złym wyborem zwykle wynika z przekonania, że musisz podjąć jedną, nieodwołalną decyzję na starcie. W praktyce można podejść do tego inaczej:

- ustalić, który framework będzie głównym standardem w zespole (np. 80% projektów),

- pozostawić sobie margines na wyjątki – dla specyficznych projektów, gdzie drugi framework ma realną przewagę,

- zaplanować strategię eksportu modeli (np. do ONNX), żeby nie być całkowicie „uwięzionym” w jednym ekosystemie,

- zainwestować trochę czasu w szablony projektów (cookiecutter, boilerplate repo), które zmniejszą koszt przełączania się między technologiami.

TensorFlow vs PyTorch w produkcji to mniej „religijna wojna”, a bardziej kwestia rozsądnego zarządzania ryzykiem technologicznym. Dobra wiadomość: w większości realnych projektów oba wybory da się obronić, jeśli są świadome i spójne z resztą architektury.

Jak myśleć o „produkcji” w uczeniu maszynowym

Wiele nieporozumień wokół wyboru frameworka bierze się z tego, że różne osoby inaczej rozumieją słowo produkcja. Dla jednej osoby „produkcja” to endpoint HTTP za modelem, który obsługuje kilkaset zapytań dziennie. Dla innej – klastry GPU, autoskalowanie, A/B testy i compliance.

Notebook na GPU a system obsługujący prawdziwy ruch

Jupyter Notebook uruchomiony na maszynie z GPU w chmurze bywa mylony z „prawdziwą” produkcją. Tymczasem kluczowe różnice to:

- Odpowiedzialność za uptime – notebook może się zawiesić, zrestartować, zamknąć wraz z sesją; serwis produkcyjny powinien działać tygodniami bez przerwy.

- Automatyzacja – w notebooku ręcznie odpalasz komórki, w produkcji wszystko musi być częścią powtarzalnych pipeline’ów (CI/CD, retraining, deployment).

- Bezpieczeństwo i dostępy – w produkcji liczą się logi, autoryzacja, audyt, czasem wymogi prawne; notebook zwykle stoi „sam sobie” w izolacji.

- Skalowanie – notebook obsługuje jedną osobę; produkcyjny endpoint musi reagować na skoki ruchu i być odporny na błędy sieciowe.

Już na poziomie tych wymagań widać, że pytanie „czy TensorFlow jest szybszy niż PyTorch” traci znaczenie, jeśli nie dodasz „w jakim scenariuszu, na jakiej infrastrukturze, w jakiej architekturze systemu”.

Kluczowe elementy środowiska produkcyjnego

Żeby sensownie porównać TensorFlow vs PyTorch w produkcji, trzeba spojrzeć na kilka powtarzających się parametrów, które decydują o tym, czy system będzie działał stabilnie i tanio:

- Latency – czas odpowiedzi na pojedyncze zapytanie (ważny w systemach online, np. rekomendacje, wyszukiwarka, asystent głosowy).

- Throughput – liczba zapytań na sekundę/minutę, którą system potrafi obsłużyć przy danym sprzęcie.

- Uptime – ile procent czasu serwis jest realnie dostępny (99%, 99,9%, więcej?).

- Monitoring – metryki techniczne (CPU, GPU, RAM, błędy), ale też metryki jakości modelu (drift, zmiana rozkładów wejść, stabilność predykcji).

- Skalowanie – jak łatwo dołożyć kolejne instancje serwisu, jak reagować na piki ruchu, jak zarządzać zasobami GPU/CPU.

- Koszty – nie tylko GPU, ale też koszty transferu danych, przechowywania modeli, prowadzenia eksperymentów.

TensorFlow i PyTorch mają inne „przyzwyczajenia”, jeśli chodzi o integrację z tymi elementami. TensorFlow oferuje dużo gotowych klocków (TFX, TF Serving, tf.data) zaprojektowanych pod duże, złożone środowiska. PyTorch z kolei częściej bywa łączony z lekkimi, elastycznymi narzędziami (FastAPI, TorchServe, Sklearn + PyTorch, ONNX Runtime), które łatwo skleić w zwinny system.

Co znaczy „production-ready” w praktyce

Określenie „production-ready” bywa nadużywane. Dopóki nie zdefiniujesz go w swoim kontekście, trudno ocenić, czy TensorFlow czy PyTorch jest „bardziej” production-ready. W praktyce można przyjąć kilka twardych kryteriów:

- Testy – przynajmniej testy jednostkowe dla kluczowych fragmentów logiki, testy integracyjne dla API, czasem testy end-to-end z danymi.

- Wersjonowanie modeli – repozytorium modeli z metadanymi, który model jest aktualnie na produkcji, jaki był dataset, jakie hyperparametry.

- Powtarzalne pipeline’y – kod, który potrafi odtworzyć proces treningu, preprocessing, deployment, bez ręcznych „haków” w notebookach.

- Kontrola zasobów – jasne limity na CPU/GPU/RAM, świadomość, które modele są „ciężkie”, a które lekkie.

- Bezpieczny rollout – możliwość wdrożenia nowej wersji modelu obok starej (canary, A/B), z prostym sposobem powrotu przy problemach.

Sam wybór frameworka niczego z tej listy nie załatwi. Ale ekosystem wokół frameworka może ułatwić lub utrudnić spełnienie tych wymagań. TensorFlow ma mocno „opiniowany” ekosystem (TFX, Model Analysis, Metadata), PyTorch jest bardziej „klockiem” do wpięcia w dowolny pipeline.

Jak framework wpływa na różne części systemu

Decyzja TensorFlow vs PyTorch dotyka różnych warstw Twojego systemu:

- Trening – implementacja modeli, zarządzanie GPU/TPU, distributed training.

- Inference – jak łatwo spakować i wystawić model (TF Serving, TorchServe, ONNX, własne API).

- Integracja z API – jak model będzie wołany przez backend (REST, gRPC, message queue, batch).

- Narzędzia MLOps – jak framework współpracuje z używanymi w organizacji narzędziami (Kubeflow, MLflow, Vertex AI, SageMaker, Azure ML).

- Narzędzia do eksperymentów – czy łatwo podłączyć logowanie eksperymentów, TensorBoard / wandb / Neptune, hyperparameter search.

Jeżeli masz już w firmie mocno obsadzony stack (np. Kubeflow + GCP + TFX), TensorFlow naturalnie wpasuje się w te klocki. Jeśli jesteś w bardziej heterogenicznym środowisku, gdzie królują lekkie mikrousługi w Dockerkach, PyTorch może być prostszy do wklejenia w istniejące procesy.

Dwa scenariusze: mały startup vs duża organizacja

Te same narzędzia mogą zachowywać się zupełnie inaczej w zależności od skali i stylu pracy zespołu.

Mały startup z jednym data scientist

Typowe cechy:

- brak wydzielonego zespołu MLOps/DevOps,

- potrzeba szybkiej walidacji pomysłów,

- częste pivoty, zmiany zakresu, przebudowy modeli,

- ograniczony budżet na sprzęt i licencje.

W takim środowisku prostota, czytelny kod i szybkie debugowanie bywają ważniejsze niż pełny, ciężki ekosystem. PyTorch z FastAPI lub Flaskiem, logowaniem do MLflow i prostym deploymentem na Dockerze bywa wtedy bardzo wygodny. TensorFlow też da się tu wykorzystać, ale bogactwo jego narzędzi często nie jest potrzebne – może nawet przeszkadzać.

Duży zespół z osobnym działem platformowym

W większej firmie:

- istnieją już standardy CI/CD,

- platformowcy tworzą wspólne komponenty i szablony,

- ważna jest powtarzalność i ujednolicenie narzędzi,

- liczy się łatwiejsze zarządzanie setkami modeli.

Tu opiniowany ekosystem TensorFlow (TFX, TF Serving, Integracje z GCP) potrafi być przewagą, bo pozwala zbudować coś w rodzaju „fabryki modeli” z powtarzalnymi elementami. PyTorch też świetnie się skaluje w takich warunkach, ale wymaga zwykle nieco więcej „sklejenia” z różnymi narzędziami – co jest łatwe, jeśli masz do tego dedykowany zespół platformowy.

Krótkie porównanie: filozofia TensorFlow i PyTorch

Spór TensorFlow vs PyTorch bardzo często sprowadza się do różnicy filozofii: ile „magii” ma za ciebie zrobić framework, a ile chcesz mieć pod pełną kontrolą.

Statyczny vs dynamiczny graf: jak to realnie wpływa na pracę

Początkowo TensorFlow reprezentował podejście „zdefiniuj graf, potem go uruchamiaj”, a PyTorch od początku stawiał na dynamiczny graf obliczeń powstający w locie przy wykonywaniu kodu Pythona. Dziś różnice mocno się zatarły (TensorFlow 2.x, eager execution, tf.function), ale ich „charakter” wciąż jest inny:

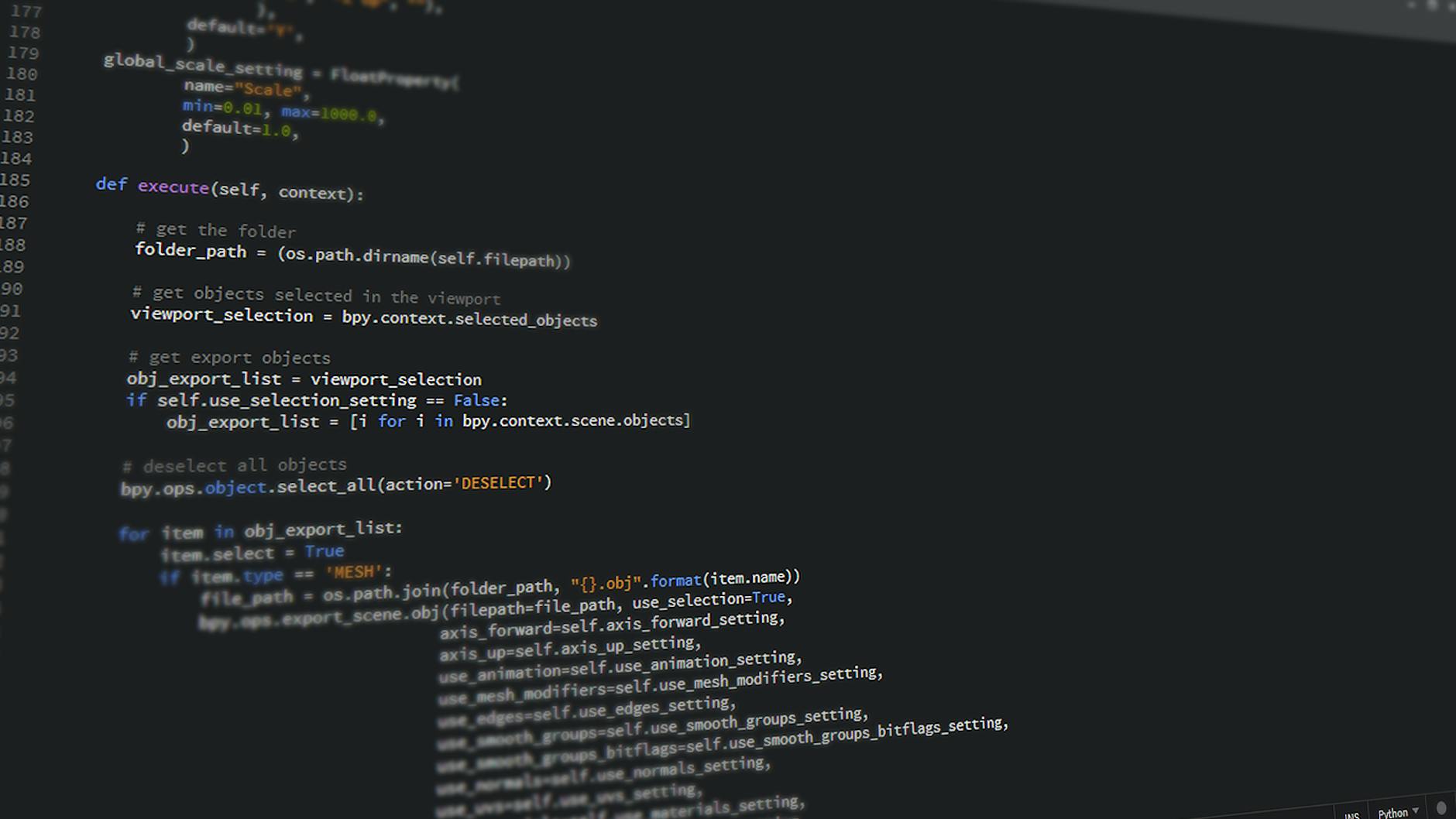

- PyTorch – kod bardzo przypomina czysty Python; łatwo debugować, używać standardowych konstrukcji języka, drukować wartości w środku forward passa.

- TensorFlow – zachęca do opakowywania logiki w funkcje, które mogą zostać „skompliowane” do grafu (

tf.function), co może dać zysk wydajności, ale wprowadza dodatkową warstwę abstrakcji.

Jedna z częstych obaw brzmi: „jeśli wybiorę TensorFlow, to debugowanie będzie koszmarem”. W wersji 2.x w znacznej mierze przestało to być prawdą, ale odczucie „bliskości do Pythona” wciąż jest po stronie PyTorch. Przy ciągłych eksperymentach i wielu nietypowych architekturach to naprawdę upraszcza życie.

Opiniowany vs modułowy ekosystem

TensorFlow wchodzi w rolę platformy: oprócz samego frameworka do trenowania modeli otrzymujesz cały zestaw narzędzi:

- TFX – pipeline’y produkcyjne (ingest danych, walidacja, trening, deployment),

- TensorFlow Serving – serwowanie modeli w wysokiej wydajności,

- TensorFlow Extended Metadata, Model Analysis – metadane eksperymentów, analiza jakości modelu.

PyTorch jest znacznie bardziej „modułowy”. Oferuje podstawowe klocki (Tensor, moduły, autograd, optimizery), a resztę dobierasz sam:

- do pipeline’ów – Kubeflow, Airflow, Prefect,

kedro, - do serwowania – TorchServe, FastAPI, BentoML, ONNX Runtime,

- do monitoringu – MLflow, Weights & Biases, Neptune.

Jeśli boisz się, że „utkniesz” w monolicie, PyTorch daje poczucie większej swobody. Jeżeli natomiast potrzebujesz jednego, spójnego zestawu narzędzi, który łatwo „sprzedać” w organizacji jako standard, TensorFlow bywa wygodniejszy.

Priorytety społeczności i tempo zmian

Odbiór frameworka to także efekt tego, czym żyje jego społeczność:

- PyTorch jest mocniej kojarzony z najnowszymi publikacjami, eksperymentalnymi architekturami, repozytoriami typu „paper to code” na GitHubie. Duża część kodu badawczego na arXiv pojawia się właśnie w PyTorch.

- TensorFlow jest silniej obecny w enterprise’owych narzędziach, gotowych produktach chmurowych i „opakowanych” rozwiązaniach (np. AutoML). Ma też potężne wsparcie pod kątem mobilnych i embedded deploymentów poprzez TensorFlow Lite.

Jeśli dużo czerpiesz z najświeższych prac naukowych, w PyTorch zwykle trafisz na implementacje szybciej. Jeśli Twoim celem jest stabilny, długo żyjący produkt, bardziej liczy się jakość integracji z chmurą i długoterminowe wsparcie niż to, czy dana funkcja była dostępna rok wcześniej czy później.

Aspekty projektowe: jaki typ zastosowania faworyzuje TensorFlow, a jaki PyTorch

Nie ma uniwersalnej odpowiedzi, ale można wskazać obszary, gdzie jeden z frameworków ma naturalny „wiatr w plecy”. Pomaga to, gdy stoisz przed konkretnym projektem, a nie abstrakcyjną dyskusją.

Modele na urządzeniach mobilnych i embedded

Jeśli celem jest model działający bezpośrednio na telefonie, w przeglądarce lub na małym urządzeniu edge, TensorFlow ma tutaj dłużej rozwijany, szeroki ekosystem:

- TensorFlow Lite – kompresja modeli, quantization, delegaty dla różnych akceleratorów (GPU, Edge TPU),

- TensorFlow.js – uruchamianie modeli w przeglądarce i w Node.js,

- narzędzia do konwersji z „dużego” TensorFlow do TFLite/TF.js.

PyTorch odpowiada m.in. PyTorch Mobile i PyTorch Live, a także integracją z ONNX, który można dalej uruchamiać w ONNX Runtime. To wystarcza w wielu przypadkach, ale jeśli Twój projekt ma silne wymagania mobilne (np. duża aplikacja konsumencka, offline inference, ścisłe ograniczenia energii), TensorFlow Lite jest bardziej „dopieszczonym” wyborem.

Ciężkie systemy rekomendacyjne, wyszukiwarki, reklama

Systemy rekomendacyjne i rankingowe w dużych firmach wymagają:

- obsługi ogromnych zbiorów cech kategorycznych,

- skomplikowanych pipeline’ów przetwarzania danych,

- często integracji z istniejącą infrastrukturą Google Cloud / BigQuery / Dataflow.

TensorFlow, historycznie wspierany przez Google w obszarze reklamy i wyszukiwania, ma dojrzałe komponenty do pracy z takimi danymi (tf.data, tf.Transform, tf.Recommenders). Narzędzia te dobrze „grają” z TFX oraz z platformami chmurowymi, które wiele firm i tak już wykorzystuje.

PyTorch oczywiście potrafi obsłużyć takie systemy, a biblioteki jak TorchRec coraz mocniej go w tym wspierają. Jednak w dużych, długowiecznych projektach, w których ciężar spoczywa na infrastrukturze i pipeline’ach danych, TensorFlow może być zwyczajnie bardziej „w domu”.

Badania, prototypowanie, nietypowe architektury

Jeśli projekt zakłada sporo pracy eksploracyjnej – tworzenie własnych warstw, modyfikacje architektury, testowanie niestandardowych funkcji straty – PyTorch daje z reguły mniej tarcia:

- łatwe wpinanie się w dowolne miejsce grafu bez walki z kompilacją,

- debugowanie przy użyciu standardowych narzędzi Pythona,

- łatwiejsza integracja z innymi bibliotekami naukowymi (NumPy, SciPy) „po drodze”.

W praktyce często wygląda to tak: zespół badawczy pracuje w PyTorch, bo szybciej iteruje, a gdy architektura się „ustabilizuje” i stanie się częścią dużej platformy, powstaje wersja produkcyjna w TensorFlow lub w PyTorch, ale już w bardziej uporządkowanym repozytorium.

Produkty oparte na wizji komputerowej i NLP

W obszarach CV i NLP wybór frameworka często wynika z ekosystemu pretrenowanych modeli i narzędzi wyższego poziomu:

- PyTorch jest mocno obecny w ekosystemie Hugging Face. Znaczna część modeli Transformers powstała najpierw na PyTorch i dopiero potem doczekała się portów TensorFlow.

- TensorFlow oferuje z kolei TensorFlow Hub oraz pakiety jak tf.keras.applications z gotowymi architekturami, ale liczba „najświeższych” modeli bywa większa po stronie PyTorch.

Jeśli Twoim głównym celem jest szybkie wykorzystanie gotowych modeli i ich lekkie dostosowanie (fine-tuning, adaptery), a nie budowa własnych architektur od zera, często łatwiej wystartować z PyTorch + Transformers, a następnie zadbać o warstwę produkcyjną wokół tego.

Zastosowania tablicowe, klasyczne machine learning + trochę deep learningu

W wielu firmach dominują dane tablicowe, a deep learning jest „dodatkiem” do klasycznych metod (gradient boosting, lasy losowe, regresje). W takim środowisku bardziej liczy się:

- łatwa integracja z scikit-learn,

- możliwość wpięcia modelu neural network w istniejące pipeline’y,

- proste API do trenowania i predykcji, które nie „straszy” reszty zespołu.

Tu różnice są mniejsze – Keras (część TensorFlow) oferuje czytelne, wysokopoziomowe API, a PyTorch można wygodnie owinąć w klasy w stylu sklearn (skorch, własne wrappery). Kluczowe pytanie brzmi: w czym zespół czuje się swobodniej. Jeśli większość osób zna scikit-learn i boi się rozbudowanych konfiguracji, Keras w trybie „Sequential + proste callbacki” może być przystępniejszy.

Ekosystem produkcyjny TensorFlow: mocne strony i ograniczenia

TensorFlow bywa postrzegany jako „cięższy”, ale w dużych środowiskach to właśnie ten „ciężar” staje się zaletą – bo oznacza gotowe, spójne klocki do zbudowania całej platformy ML.

TFX – pipeline’y od danych po deployment

TensorFlow Extended (TFX) to zestaw komponentów pozwalających zbudować powtarzalny, audytowalny proces od surowych danych aż po model na produkcji. W skład TFX wchodzą m.in.:

- ExampleGen – wczytywanie danych do pipeline’u,

- StatisticsGen i SchemaGen – statystyki danych i automatyczne propozycje schematu,

- ExampleValidator – wykrywanie anomalii w danych (brakujące cechy, zmiany rozkładów),

- Transform – deklaratywne definicje preprocessing’u współdzielonego między treningiem a inference,

- Trainer – komponent treningowy,

- Pusher – wdrożenie nowego modelu do serwisu.

Dla części osób taki zestaw może na początku wydawać się przytłaczający. Gdy jednak pojawiają się wymagania typu:

- „musimy mieć historię zmian w danych wejściowych”,

- „nie możemy wypuścić modelu, który został przetrenowany na niezwalidowanym schemacie danych”,

- „audyt chce widzieć, jak zmieniały się rozkłady cech przez ostatni rok”

– TFX daje przewagę. Komponenty mają wbudowaną integrację z ML Metadata, dzięki czemu łatwiej śledzić pełną ścieżkę powstawania modelu (dane → transformacje → trening → metryki → artefakty).

TensorFlow Serving – wysokowydajne serwowanie modeli

TensorFlow Serving to specjalizowany serwer inference, który ładuje modele zapisane w formacie SavedModel i wystawia je poprzez:

- gRPC (zalecane w systemach o dużym ruchu),

- REST (wygodne w prostszych integracjach).

Kluczowe cechy z punktu widzenia produkcji:

- łatwa rotacja wersji – w tym samym serwerze możesz mieć kilka wersji modelu, zmieniać „aktualną” bez restartu procesu,

- optymalizacje wydajnościowe – batching zapytań, wykorzystanie wielu rdzeni i GPU bez pisania własnego kodu,

- gotowe health checki – przydatne w orkiestracji przez Kubernetesa czy inne systemy.

Jeśli Twój zespół backendowy woli „po prostu mieć stabilny kontener, który dostaje tensory i zwraca tensory”, TF Serving bywa bardzo wygodny. Z drugiej strony – narzuca określony sposób pakowania modeli i format danych. Dla prostszych projektów, szczególnie na początku, takie podejście może być zbyt sztywne; wtedy często wygrywa prosty serwis REST napisany w ulubionym frameworku (Flask/FastAPI) z wbudowanym wywołaniem model.predict().

Integracja z chmurą (szczególnie GCP)

TensorFlow był od początku rozwijany z myślą o pracy w dużych środowiskach chmurowych, co widać w liczbie integracji:

- Vertex AI (GCP) – gotowe szablony pipeline’ów TFX, trenowanie rozproszone na klastrach GPU/TPU, automatyczny deployment do endpointów serwisowych,

- AI Platform / AI Hub (starsze komponenty GCP) – również były silnie zorientowane na TensorFlow,

- obsługa TPU – jeśli Twoja firma korzysta z TPU w Google Cloud, TensorFlow jest pierwszorzędnym obywatel.

Na AWS i Azure TensorFlow także ma mocne wsparcie (SageMaker, Azure ML), ale w GCP ta integracja jest szczególnie głęboka. W praktyce, jeśli organizacja już standardowo korzysta z GCP pod analitykę i dane, wiele gotowych komponentów „z pudełka” będzie zakładać użycie TensorFlow.

tf.data, tf.Transform i spójność preprocessing’u

Jedno z typowych źródeł błędów w produkcji to rozjazd między preprocessingiem w treningu a preprocessingiem podczas inference. TensorFlow stara się ten problem ograniczyć na kilka sposobów:

tf.data– wydajne strumieniowanie danych z plików, baz, GCS/S3; łatwe tworzenie złożonych pipeline’ów (shuffle, cache, prefetch, mapowanie w wielu wątkach),tf.Transform– definiowanie transformacji danych w postaci funkcji TensorFlow, które można użyć zarówno podczas treningu, jak i w serwisie inference (np. normalizacja, bucketization, one-hot encoding).

Monitorowanie, audyt i „ślad” modelu w ekosystemie TensorFlow

Gdy model trafia na produkcję, przestaje chodzić tylko o metryki z walidacji. Dochodzą pytania o to, kto, kiedy i na jakich danych model powstał, czym różni się od poprzedniej wersji i co się działo z danymi wejściowymi przez ostatnie miesiące.

TensorFlow, szczególnie w połączeniu z TFX, daje spójny zestaw narzędzi do budowania takiego „śladu”:

- ML Metadata (MLMD) – przechowywanie informacji o artefaktach (dane, modele, metryki), ich wersjach i zależnościach między nimi,

- TensorFlow Model Analysis (TFMA) – analiza jakości modelu po treningu i w trybie batch, z możliwością rozbijania metryk na segmenty (np. kraj, typ klienta),

- TFX Evaluator – automatyczne porównywanie nowego modelu z poprzednim, z regułami typu „zaakceptuj tylko, jeśli AUC nie spadnie więcej niż X na żadnym z kluczowych segmentów”.

W praktyce wygląda to tak: nowa wersja modelu przechodzi przez pipeline TFX, powstają metryki z walidacji, a Evaluator podejmuje decyzję, czy wolno ją wypchnąć dalej. Wszystko zostaje zapisane w MLMD, co ułatwia późniejsze rozmowy z audytem czy biznesem. Zamiast „chyba użyliśmy danych z Q1”, widać konkretny zestaw artefaktów, commit kodu i konfigurację hiperparametrów.

Dla zespołów, które dopiero startują z produkcją ML, to może wyglądać jak ciężka artyleria. Ale gdy raz pojawi się incydent typu „model został przetrenowany na częściowo zepsutych danych i nikt nie wie, kiedy to się stało”, argument za takim podejściem staje się bardzo namacalny.

Ograniczenia i pułapki ekosystemu TensorFlow

Mocny, rozbudowany ekosystem ma też ciemniejszą stronę. W codziennej pracy pojawiają się typowe frustracje:

- krzywa uczenia – TFX, TF Serving, SavedModel, tf.Example… to inny świat niż prosty notebook z

model.fit(), - sztywność formatów – wejście/wyjście modeli często trzeba dopasować do oczekiwań narzędzi (np. tf.Example, signature’y w SavedModel),

- kompatybilność wersji – w dużych projektach aktualizacja TensorFlow + TFX + Beam + Airflow/Kubeflow potrafi zająć tygodnie.

Można też przesadzić w drugą stronę: budować „enterprise’owy” ekosystem do rozwiązań, które spokojnie ogarnęłaby jedna aplikacja FastAPI i kilka skryptów cron. Jeśli zespół jest mały, a projekt nie ma wymagań regulacyjnych, zdarza się, że lżejsze podejście (np. PyTorch + własne pipeline’y w Airflow/Prefect) daje więcej elastyczności i mniej blokad.

Dobrym filtrem jest pytanie: co będzie prawdziwym bólem za rok? Jeśli spodziewasz się dziesiątek modeli, wielu zespołów i potrzeby formalnego audytu – inwestycja w pełny ekosystem TensorFlow zwróci się szybciej. Jeśli priorytetem jest tempo eksperymentów i dopasowywanie się do zmieniających się wymagań produktu, cięższe narzędzia mogą tylko spowolnić pracę.

Ekosystem produkcyjny PyTorch: swoboda, którą trzeba okiełznać

PyTorch startował jako narzędzie „od naukowców dla naukowców”. Gdy coraz więcej firm zaczęło używać go także na produkcji, powstał szereg bibliotek i usług, które mają wypełnić lukę między notatnikiem a stabilnym serwisem.

TorchServe i alternatywy do serwowania modeli

W świecie PyTorch nie ma jednego „kanonicznego” sposobu serwowania modeli, ale kilka dojrzałych rozwiązań się wykrystalizowało.

TorchServe to projekt rozwijany m.in. przez AWS i Meta, który pełni rolę odpowiednika TF Serving:

- ładuje modele zapisane w formacie Mar lub bezpośrednio z plików Python/Checkpoint,

- umożliwia serwowanie wielu modeli w jednym procesie, z routingiem po nazwie lub wersji,

- obsługuje batching, autoskalowanie replik, endpointy REST i gRPC.

Model opisuje się w tzw. handlerze – klasie, która definiuje preprocessing, wywołanie modelu i postprocessing. To jednocześnie siła i słabość: daje pełną kontrolę, ale wymaga więcej kodu niż w prostym model.predict() w serwisie Flask.

Niektóre zespoły idą inną drogą i opierają się na:

- FastAPI/Flask z ręcznie zarządzanym lifecycle’em modelu (ładowanie przy starcie, współdzielenie między żądaniami),

- frameworkach typu BentoML, KServe, Seldon, które potrafią serwować modele w różnych formatach (w tym PyTorch) i zapewniają gotowy „runtime” kontenerowy.

To podejście daje sporą elastyczność. Można bez problemu wpleść dodatkową logikę biznesową, reguły, cache czy fallback do prostszych heurystyk. Dla małych i średnich zespołów często jest to wygodniejsze niż uczenie się osobnego, wyspecjalizowanego serwera do inference.

PyTorch Lightning, Hydra i porządkowanie kodu eksperymentów

PyTorch daje pełną swobodę, ale szybko pojawia się chaos: powielone pętle trenowania, ręczne logowanie metryk, konfiguracja rozrzucona po kilku plikach. Gdy taki kod trzeba wdrożyć na produkcję, każda zmiana boli.

Dlatego tak popularne stały się biblioteki „porządkujące”:

- PyTorch Lightning – wydziela pętlę treningową, checkpointing, logowanie metryk i trenowanie rozproszone w jeden, spójny interfejs. Modelopisujesz jako

LightningModule, a resztą zarządza „trener”. - Hydra – zarządzanie konfiguracją (YAML + nadpisywanie z CLI), co ułatwia powtarzalne eksperymenty i przenoszenie ich do środowisk CI/CD.

Z perspektywy produkcji taki stack ma jedną dużą zaletę: zmniejsza różnicę między kodem badawczym a kodem produkcyjnym. Trzeba oczywiście wyciąć elementy stricte eksploracyjne, ale struktura projektu, sposób ładowania danych czy konfiguracji pozostaje ten sam.

Niektóre firmy idą krok dalej i narzucają zespołom wewnętrzne szablony repozytoriów: katalog na dane wejściowe, osobny moduł na modele, spójne interfejsy do trenowania i ewaluacji. Dla części osób to ograniczenie, dla innych – ulga, bo zmniejsza liczbę decyzji przy każdym nowym projekcie.

ONNX, TorchScript i optymalizacja inference

Jedno z częstszych pytań brzmi: „czy PyTorch jest wolniejszy na produkcji niż TensorFlow?”. Odpowiedź zależy od tego, jak serwujesz model.

PyTorch daje kilka ścieżek optymalizacji:

- TorchScript – kompilacja modelu (przez tracing lub scripting) do statycznej reprezentacji, którą można ładować w lekkim runtime’ie C++ bez Pythona,

- ONNX – eksport modelu do wspólnego formatu, który potem można wykonywać w wysokowydajnych silnikach (ONNX Runtime, TensorRT, OpenVINO),

- optimizery typu

torch.compile(w nowych wersjach) – próba automatycznej kompilacji grafu do bardziej wydajnej postaci.

To otwiera ciekawe opcje architektoniczne. Można trenować model w PyTorch, a następnie:

- wyeksportować go do ONNX i serwować przez ONNX Runtime na CPU/GPU,

- skompilować do TensorRT i wdrożyć na urządzenia edge,

- użyć TorchScript w lekkim serwisie C++ o minimalnych zależnościach.

Minusem jest to, że nie każdy model przechodzi gładko przez taki proces – szczególnie te z niestandardowymi warstwami lub skomplikowaną logiką sterującą. Czasem kończy się na utrzymywaniu dwóch wersji: „badawczej” z pełną swobodą i „produkcyjnej” z uproszczonymi, lepiej wspieranymi operatorami.

Brak jednego „oficjalnego” pipeline’u – plus czy minus?

W odróżnieniu od ekosystemu TensorFlow, w PyTorch nie ma jednego wskazanego sposobu budowania pipeline’u end-to-end. Zamiast TFX dostajesz zestaw klocków, które trzeba samodzielnie złożyć:

- orchestration: Airflow, Kubeflow, Prefect, Dagster lub własne narzędzia,

- feature store: Feast, Hopsworks, własne tabele w data warehouse,

- monitoring: Prometheus + Grafana, Evidently, Arize, Fiddler i inne,

- rejestr modeli: MLflow, Neptune, W&B, Vertex AI Model Registry itd.

Dla jednych to przekleństwo – bo trudniej o gotowe, sprawdzone ścieżki. Dla innych błogosławieństwo – bo można dobrać narzędzia pod istniejący stack (np. „u nas wszystko stoi na Airflow + Snowflake, więc dołóżmy tam logicznie PyTorch”).

Jeśli czujesz się przytłoczony liczbą opcji, rozsądną strategią jest wybranie jednego, spójnego zestawu „domyślnych” narzędzi dla zespołu. Na przykład: „modele trenujemy w PyTorch Lightning, logujemy do MLflow, orkiestrujemy w Airflow, serwujemy przez FastAPI + ONNX Runtime”. To nie musi być idealne na wieczność, ale porządkuje pierwsze kilka lat rozwoju platformy.

Jak dopasować wybór frameworka do realiów organizacji

Rzadko kiedy pytanie „TensorFlow czy PyTorch?” da się uczciwie rozstrzygnąć w próżni. Na wynik wpływa to, kim są ludzie w zespole, jaki jest stack firmy i jakie ograniczenia narzuca branża.

Profil zespołu: badacze kontra inżynierowie

W zespołach, w których dominują osoby z zapleczem akademickim, często słychać: „w PyTorchu po prostu się lepiej myśli o modelu”. Elastyczny, imperatywny styl programowania, łatwe logowanie wszystkiego w notatniku, debugowanie jak dowolnego kodu Pythona – to buduje poczucie kontroli.

Z kolei zespoły mocno inżynierskie, przyzwyczajone do projektowania systemów rozproszonych, mogą doceniać bardziej „systemowe” podejście TensorFlow z jego SavedModel, signature’ami i spójnym formatem danych. Tam, gdzie na co dzień operuje się mikroserwisami, message queue i kontraktami API, sztywniejszy kontrakt modelu bywa zaletą, bo ułatwia integrację z resztą systemu.

Czasem najlepszym rozwiązaniem jest rozdzielenie ról: część badawcza korzysta z PyTorch, a zespół platformowy oferuje usługę wdrożenia (port do TensorFlow lub ustandaryzowany sposób serwowania PyTorch). To oczywiście kosztuje – każda translacja to potencjalny punkt awarii – ale w dużych organizacjach bywa realistycznym kompromisem.

Stack technologiczny firmy i „naturalne” integracje

Kolejny filtr to to, z czego firma już korzysta:

- jeśli analityka i dane stoją głównie na GCP (BigQuery, Vertex AI, Dataflow), TensorFlow i TFX będą się w to naturalnie wplatać,

- jeśli dominują AWS + SageMaker, różnice się zacierają – SageMaker oferuje dobre wsparcie i dla TensorFlow, i dla PyTorch,

- jeśli duża część systemów jest napisana w C++/Java i wymaga wbudowania inference „w środku” aplikacji, łatwiej wykorzystać runtime’y C++ (TF C API, ONNX Runtime, TorchScript).

Czasem kluczowy jest wręcz jeden element: np. urządzenia brzegowe, na których musi działać inference. Jeśli producent zapewnia gotowe SDK zoptymalizowane pod TensorFlow Lite, walka o „przepchnięcie” PyTorch może po prostu nie być warta wysiłku. W odwrotną stronę działa to przy integracjach z dużymi modelami z Hugging Face – tam PyTorch jest często pierwszym, najlepiej wspieranym obywatel.

Regulacje, compliance i potrzeba śledzenia decyzji

W branżach regulowanych (finanse, medycyna, ubezpieczenia) kwestia audytu i wyjaśnialności potrafi zdominować dyskusję. Potrzebne są:

- dokumentacja procesu treningu,

- możliwość odtworzenia konkretnej wersji modelu,

- wgląd w rozkłady danych i metryki w czasie.

Tutaj TensorFlow + TFX + MLMD dają przewagę „z pudełka”. Da się to oczywiście zbudować także wokół PyTorch (np. z MLflow, własnym repositorium artefaktów i bibliotekami do monitoringu driftu), ale wymaga to więcej decyzji projektowych i pracy konfiguracyjnej.

Dla organizacji, które dopiero zaczynają przygodę z ML i jednocześnie są mocno regulowane, przyjęcie bardziej „opinioned” ekosystemu TensorFlow bywa bezpieczniejszą ścieżką – mniej wolności, ale też mniej sposobów, żeby przypadkiem obejść dobre praktyki.

Cykl życia produktu i stabilność wymagań

Inaczej wybiera się narzędzia do produktu, który ma żyć kilka lat z umiarkowanymi zmianami, a inaczej do eksperymentalnych funkcji, które co kwartał mogą zostać wyrzucone lub napisane na nowo.

Najczęściej zadawane pytania (FAQ)

TensorFlow czy PyTorch – co lepiej wybrać do produkcji?

Nie ma jednej poprawnej odpowiedzi dla wszystkich projektów. Dojrzałe środowiska produkcyjne z rozbudowanym MLOps, szczególnie mocno oparte o Google Cloud, często łatwiej „dogadują się” z TensorFlow i ekosystemem TFX/TF Serving. Z kolei zespoły, które stawiają na szybkie iteracje, prosty kod i większą elastyczność, częściej wybierają PyTorch z lekkimi narzędziami wokół (FastAPI, ONNX Runtime, własne serwisy na Kubernetesie).

Kluczowe pytanie brzmi: który framework najmniej utrudni rozwój i utrzymanie twojego konkretnego systemu w ciągu najbliższych 12–24 miesięcy. Jeśli firma ma już infrastrukturę „pod” TensorFlow, grą jest raczej wykorzystanie tego atutu niż religijna zmiana na PyTorch. Jeśli startujesz od zera i liczy się szybkość eksperymentów, PyTorch bywa prostszy na rozruch.

Czy do nauki lepszy jest PyTorch, a do produkcji TensorFlow?

To częsty schemat myślenia, ale mocno uproszczony. PyTorch faktycznie jest często postrzegany jako „przyjemniejszy” do nauki i badań, bo kod bardziej przypomina zwykłe PyThonowe programowanie. TensorFlow natomiast ma bogatszy zestaw narzędzi do dużych pipeline’ów produkcyjnych (TFX, tf.data, TF Serving).

Jednak oba frameworki są w praktyce używane zarówno w badaniach, jak i w krytycznych systemach produkcyjnych. Jeśli zespół świetnie zna PyTorch i ma wokół niego zbudowane narzędzia, nie ma powodu na siłę przenosić się na TensorFlow tylko dlatego, że „jest bardziej produkcyjny”. Lepiej dopasować narzędzia do kompetencji ludzi i istniejącego środowiska.

Jakie kryteria brać pod uwagę przy wyborze między TensorFlow a PyTorch w firmie?

Zamiast porównywać tylko „szybkość” czy „nowoczesność”, bardziej praktyczne jest spojrzenie na kilka obszarów:

- jak framework integruje się z aktualnym stackiem (GCP, AWS, narzędzia CI/CD, monitoring),

- jak łatwo będzie serwować kolejne wersje modelu i robić roll-back,

- czy nowi członkowie zespołu szybko zrozumieją kod i standardy pracy,

- jak wygląda debugowanie problemów już po wdrożeniu (logi, profiling, narzędzia diagnostyczne).

Dopiero w tym kontekście ma sens pytanie o framework. Ten sam wybór może być świetny w małym startupie i kompletnie nieopłacalny w korporacji z rozbudowaną infrastrukturą – i odwrotnie.

Czy zły wybór frameworka oznacza, że kiedyś będę musieć przepisać wszystko od zera?

To realna obawa, ale zwykle bardziej dramatyczna niż rzeczywistość. Najtrudniej zmienić nie sam kod modelu, ale „oprawę” produkcyjną: formaty artefaktów (SavedModel, TorchScript, ONNX), sposób serwowania (TF Serving, TorchServe, własne API), proces MLOps (wersjonowanie modeli, A/B testy, roll-back) czy ustalone standardy zespołu.

Samą architekturę modelu często i tak refaktoryzuje się kilka razy w cyklu życia produktu. Jeśli od początku planujesz choćby minimalną strategię eksportu (np. do ONNX) i trzymasz się rozsądnych standardów, przejście z jednego frameworka na drugi jest bolesne, ale rzadko oznacza całkowite zaczynanie od zera.

Kiedy ma sens wybrać TensorFlow, a kiedy PyTorch w projekcie SaaS?

W długoterminowym produkcie SaaS liczy się przewidywalność i łatwość utrzymania. TensorFlow bywa dobrym wyborem, gdy:

- masz silne powiązanie z ekosystemem Google (GCP, Vertex AI),

- budujesz złożone pipeline’y z walidacją danych, trenowaniem, deployem (TFX),

- chcesz korzystać z gotowych, „pudełkowych” klocków produkcyjnych (TF Serving, tf.data).

PyTorch częściej wygrywa, gdy:

- zespół ceni sobie prostotę kodu i szybkie eksperymenty,

- infrastruktura jest lekka, oparta o własne mikrousługi (FastAPI, Kubernetes),

- używasz wielu narzędzi open-source, które naturalnie integrują się z PyTorchem (Lightning, FastAI, ONNX Runtime).

Czym różni się „notebook na GPU” od prawdziwej produkcji w kontekście wyboru frameworka?

Notebook na GPU służy głównie do eksperymentowania: ktoś ręcznie odpala komórki, coś się wysypie – restartuje kernel i idzie dalej. Produkcja to inna gra: endpoint musi mieć wysoki uptime, działać tygodniami, skalować się przy pikach ruchu, logować wszystko, co dzieje się z modelem i danymi, a do tego mieścić się w budżecie.

W tym świecie liczy się nie tylko to, jak pisze się sam model, ale także:

- latency i throughput przy danej infrastrukturze,

- łatwość skalowania i monitoringu,

- integracja z CI/CD, systemem logów, systemami bezpieczeństwa.

Dopiero gdy masz na stole te wymagania, sensownie widać, czy TensorFlow czy PyTorch lepiej pasuje do twojej definicji „produkcji”.

Czy mogę używać w zespole jednocześnie TensorFlow i PyTorch?

Tak, to częstsze niż się wydaje. Jedną z rozsądnych strategii jest ustalenie jednego frameworka jako „domyślnego” (np. 70–80% projektów), a pozostawienie przestrzeni na wyjątki – szczególnie tam, gdzie drugi framework daje realną przewagę (np. dostęp do konkretnego repozytorium modeli, lepsze wsparcie na danej platformie, wymagania klienta).

Pomaga wtedy kilka rzeczy: szablony repozytoriów (cookiecutter), wspólne standardy MLOps niezależne od frameworka (np. formaty artefaktów, sposób wersjonowania, monitoring) oraz strategia eksportu modeli (np. ONNX). Dzięki temu zespół nie jest „uwięziony” w jednym ekosystemie, a koszt przełączania się między technologiami pozostaje akceptowalny.