Po co w ogóle przejmować się komputerami kwantowymi?

Jeśli prowadzisz firmę, odpowiadasz za systemy IT albo chociaż przechowujesz wrażliwe dane klientów, kluczowe pytanie brzmi: jak długo te dane muszą pozostać poufne? Rok, pięć lat, dwadzieścia? Od odpowiedzi zależy, czy problem komputerów kwantowych można zignorować, czy trzeba zaplanować konkretne działania na najbliższe lata.

Dla części organizacji komputery kwantowe to wciąż egzotyczna ciekawostka. Z drugiej strony coraz częściej pojawia się hasło: „store now, decrypt later” – przechowaj teraz, odszyfruj później. Oznacza ono, że atakujący może dziś przechwytywać zaszyfrowany ruch (np. TLS/HTTPS, VPN), a za 10–15 lat odszyfrować go z pomocą dojrzałego komputera kwantowego. Czy twoje dane przestaną być wtedy wrażliwe?

Jakie decyzje odłożysz na później, jeśli uznasz kwant za „problem przyszłości”?

Załóżmy, że mówisz sobie: „kwanty to temat na 2040+, teraz mam ważniejsze rzeczy”. Jakie decyzje automatycznie odkładasz?

- Przegląd stosowanych algorytmów kryptograficznych (RSA, ECC, stare krzywe, krótkie klucze).

- Plan migracji do kryptografii post‑kwantowej – nawet jeśli dziś jeszcze jej nie wdrożysz.

- Uwzględnienie wymagań przyszłych regulacji (np. w sektorze finansowym, publicznym) w obecnych projektach.

- Projektowanie nowych systemów z myślą o łatwej wymianie mechanizmów szyfrowania (tzw. crypto‑agility).

- Analizę ryzyka dla danych długoterminowych – np. medycznych, finansowych, tajemnic państwowych, własności intelektualnej.

Jeśli prowadzisz małego bloga – faktycznie możesz spać spokojnie. Ale jeśli budujesz system finansowy, platformę medyczną albo przechowujesz archiwa umów na dekady, odłożenie decyzji oznacza świadomą zgodę na to, że w pewnym momencie nagle obudzisz się z przestarzałą kryptografią, której wymiana będzie bardzo kosztowna i chaotyczna.

Pytanie do ciebie: czy masz w głowie choćby orientacyjny rok, w którym twoje dzisiejsze dane przestaną być wrażliwe? Jeśli nie – warto go określić, choćby zgrubnie.

Ciekawostka naukowa czy realne ryzyko dla biznesu?

Komputer kwantowy, który robi „quantum supremacy” na specjalnie dobranym zadaniu, a komputer kwantowy, który łamie RSA 2048 – to dwa zupełnie różne światy. Marketing często wrzuca je do jednego worka, ale z punktu widzenia bezpieczeństwa liczy się tylko to drugie.

Ryzyko staje się realne wtedy, gdy:

- powstają komputery kwantowe z milionami kubitów fizycznych zdolnych do korekcji błędów (kubitów logicznych),

- algorytmy takie jak Shor i Grover działają w skali standardowych kluczy (RSA 2048, ECC‑256, rzeczywiste funkcje skrótu używane w protokołach),

- pojawi się praktyczne oprogramowanie i usługi „quantum‑as‑a‑service”, które umożliwią atakującym wykorzystanie kwantu bez posiadania własnego laboratorium.

Naukowe rekordy typu „obliczyliśmy coś na 127 kubitach” są imponujące, ale jeszcze nie przekładają się na możliwość złamania twojego VPN. Jednak tempo rozwoju jest na tyle duże, że ignorowanie tematu przez całą dekadę to raczej zły pomysł.

Scenariusze: administracja, bank, software house, użytkownik prywatny

Dla kogo kwantowe łamanie szyfrów to realny scenariusz, a dla kogo raczej kwestia ciekawostki? Spójrz na kilka uproszczonych przykładów:

Administracja publiczna

Państwowe systemy gromadzą dane o obywatelach na dziesięciolecia: dokumentacja medyczna, rejestry gruntów, dane podatkowe, materiały wywiadowcze. Atakujące państwo może już dziś masowo przechwytywać zaszyfrowany ruch innego państwa i archiwizować go. Po pojawieniu się dojrzałych komputerów kwantowych będzie w stanie odtworzyć historię komunikacji. Dla administracji oznacza to konieczność myślenia w horyzoncie 20–30 lat.

Bank lub instytucja finansowa

Banki są naturalnym celem ataku typu „store now, decrypt later”. Nagranie szyfrowanego ruchu z kanałów bankowości elektronicznej, systemów SWIFT, komunikacji między instytucjami może w przyszłości pozwolić na analizę transakcji, modeli ryzyka, a w pewnych scenariuszach nawet na rekonstrukcję danych klientów. Do tego dochodzą długoterminowe podpisy cyfrowe pod umowami, instrumentami finansowymi czy raportami regulacyjnymi. Tu horyzont poufności jest często liczony w dekadach.

Mały software house

Wyobraź sobie małą firmę, która tworzy system SaaS dla klientów z UE, przetwarzający dane osobowe i dokumenty. Odpowiadasz za architekturę: jakich algorytmów szyfrowania używasz dzisiaj? Jak zaprojektujesz system, żeby dało się bez bólu wymienić warstwę kryptografii? Nawet jeśli sama firma nie przetrwa 20 lat, dane klientów mogą już być przechowywane po twoim odejściu. Dla software house’u kluczowe jest teraz: projektować systemy z crypto‑agility i śledzić standardy (NIST, IETF).

Użytkownik prywatny

Jeśli szyfrujesz dysk laptopa albo korzystasz z messengera typu end‑to‑end, pytanie brzmi: czy ktoś ważny dla ciebie będzie chciał wrócić do twoich danych za 15 lat? Dla większości prywatnych użytkowników komputer kwantowy nie jest bezpośrednim zagrożeniem na dziś, ale jeśli przechowujesz bardzo wrażliwe materiały (np. informacje polityczne, aktywizm w kraju autorytarnym), horyzont czasowy bezpieczeństwa może być znacznie dłuższy.

Na ile lat twoje dane muszą pozostać poufne?

To pytanie warto zadać sobie wprost, np. dla każdej klasy danych:

- dane transakcyjne: 5–10 lat?

- dokumentacja medyczna: całe życie pacjenta + okres po śmierci?

- tajemnice handlowe: dopóki produkt jest na rynku lub konkurencja może skorzystać?

- dane wywiadowcze / wojskowe: 20–50 lat?

Jeżeli choć jedna ważna kategoria danych ma horyzont poufności > 10 lat, temat komputerów kwantowych przestaje być czystą teorią, a staje się elementem realnej strategii bezpieczeństwa. Pomyśl: jakie typy danych w twojej firmie muszą „przetrwać kwant”?

Co właściwie robi komputer kwantowy inaczej niż klasyczny?

Żeby ocenić, kiedy komputery kwantowe zagrożą szyfrowaniu, trzeba z grubsza zrozumieć, co one tak naprawdę robią. Nie chodzi o pełny wykład z fizyki kwantowej, ale o intuicję: dlaczego pewne zadania (jak łamanie RSA) przyspieszają dramatycznie, a inne – wcale.

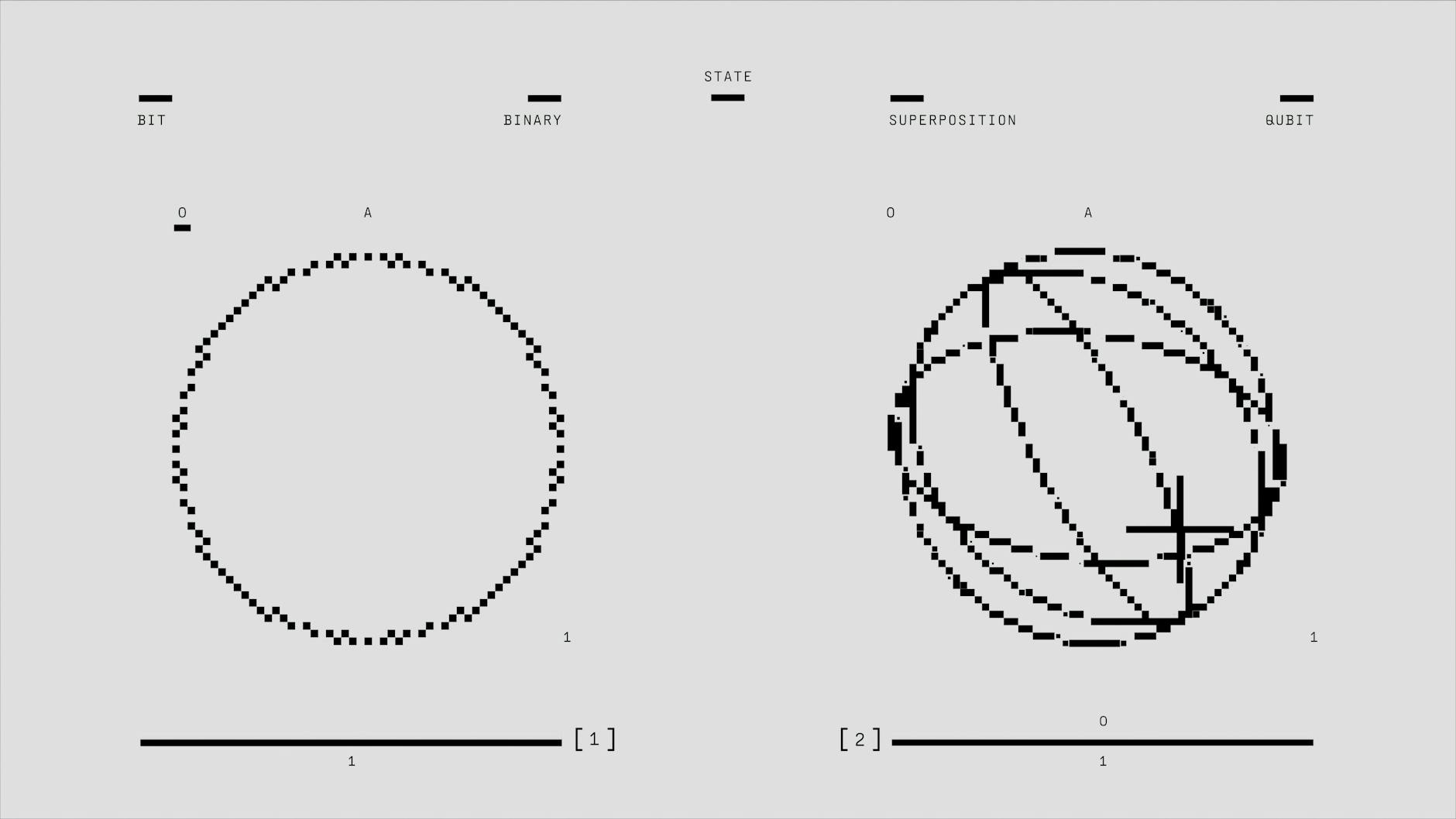

Qubit, superpozycja, splątanie – po ludzku

Klasyczny komputer operuje na bitach: 0 albo 1. Każda komórka pamięci ma konkretną wartość w danej chwili. W komputerze kwantowym podstawową jednostką jest qubit, który może być w stanie 0, 1 albo w superpozycji obu naraz.

Intuicja qubitu kontra bitu

Najprostsza analogia: bit to moneta leżąca na stole – reszka (0) albo orzeł (1). Qubit to moneta wirująca w powietrzu: dopóki jej nie „obserwujesz” (nie mierzysz), nie ma ustalonego wyniku. Jest opisywana rozkładem prawdopodobieństwa: np. 70% szans na orła, 30% na reszkę. Pomiar „zatrzymuje monetę” i daje konkretny wynik, zgodnie z tymi prawdopodobieństwami.

Co ważne: superpozycja nie oznacza, że komputer „zawiera wszystkie odpowiedzi naraz” w magiczny sposób. Umożliwia raczej wykonywanie obliczeń na kombinacji wszystkich stanów równocześnie, ale później trzeba „wyciągnąć” z tego wynik za pomocą sprytnego algorytmu, który wzmacnia prawdopodobieństwo poprawnej odpowiedzi.

Splątanie i interferencja jako „klej” i „filtr”

Kiedy masz więcej niż jeden qubit, pojawia się zjawisko splątania. To tak, jakby dwie wirujące monety były ze sobą związane: wynik jednej jest powiązany z wynikiem drugiej, nawet jeśli znajdują się daleko od siebie. Matematycznie: ich stan opisuje wspólna funkcja, a nie niezależne prawdopodobieństwa.

Interferencja to z kolei sposób, w jaki poszczególne „ścieżki obliczeniowe” mogą się wzmacniać lub wygaszać. Dobry algorytm kwantowy tak steruje ewolucją stanu, aby niepoprawne odpowiedzi „znosiły się” (mały udział w superpozycji), a poprawne były wzmacniane (duże prawdopodobieństwo przy pomiarze).

Bez splątania i interferencji komputery kwantowe byłyby jedynie ciekawą zabawką probabilistyczną. To te efekty sprawiają, że da się osiągnąć przyspieszenia, które całkowicie zmieniają krajobraz kryptografii asymetrycznej.

Dlaczego to ma znaczenie dla szyfrowania

Co takiego robi kwant, czego nie potrafi klasyczny komputer, że nagle RSA 2048 przestaje być bezpieczne? Kluczem jest to, jak kwant potrafi przetwarzać bardzo duże przestrzenie stanów.

Superpozycja a przeszukiwanie dużych przestrzeni

W klasycznym „brute force” sprawdzasz kolejne klucze po kolei: 000…, 001…, 010… itd. Jest to liniowe przeszukiwanie przestrzeni o rozmiarze 2n (dla n‑bitowego klucza). Algorytmy kwantowe, dzięki superpozycji, potrafią wykonać operacje na wszystkich możliwych kluczach naraz, a następnie wykorzystać interferencję, żeby „wyciszyć” większość błędnych odpowiedzi.

Jednakże nie oznacza to zawsze drastycznego skrócenia czasu. Dla wielu problemów przyspieszenie jest „tylko” kwadratowe (jak w Groverze): z 2n do 2n/2. Rewolucja następuje dla specyficznych zadań, takich jak faktoryzacja dużych liczb czy problem logarytmu dyskretnego, gdzie algorytm Shora zapewnia czas wielomianowy, zamiast wykładniczego. To jest prawdziwy cios w RSA i ECC.

Probabilistyczna natura wyników

Komputer kwantowy nie zwraca deterministycznej odpowiedzi w jednym przebiegu. Wynik jest losowy z określonym rozkładem. W praktyce oznacza to, że wiele algorytmów trzeba wykonać wielokrotnie, aby zwiększyć prawdopodobieństwo poprawności (np. do 99,999%).

Dla bezpieczeństwa szyfrowania istotne jest, że średni czas ataku na konkretny algorytm (np. RSA 2048) maleje z astronomicznego – praktycznie nieskończonego – do realistycznego, liczonego w godzinach/dniach przy odpowiednio dużym komputerze kwantowym. Probabilistyczność nie „ratuje” szyfru, tylko wymaga większej liczby powtórzeń – wciąż drastycznie szybszych niż na klasycznym sprzęcie.

Czego oczekujesz od kwantu: przyspieszenia wszystkiego czy konkretnych zadań?

Jeśli myślisz o komputerach kwantowych jako o superkomputerach przyspieszających wszystko, zderzysz się z rozczarowaniem. Przyspieszenia (często dramatyczne) występują tylko dla pewnych klas problemów. Dla większości codziennych zadań (przeglądarka, Excel, gry) kwant nic nie zmienia.

Z punktu widzenia bezpieczeństwa najistotniejsze pytanie brzmi: czy zadanie, które stoi za bezpieczeństwem mojego algorytmu kryptograficznego, ma znany efektywny algorytm kwantowy? Dla RSA i ECC odpowiedź brzmi „tak” – Shor. Dla AES – „tylko” częściowe przyspieszenie – Grover. Pomyśl: do czego dziś używasz kryptografii w swojej infrastrukturze i które z tych mechanizmów opierają się o problem faktoryzacji lub logarytmu dyskretnego?

Jak działa dzisiejsze szyfrowanie: co jest naprawdę zagrożone?

Nie wszystko, co nazywamy „szyfrowaniem”, padnie ofiarą komputerów kwantowych w tym samym stopniu. Kluczowa jest różnica między kryptografią symetryczną a asymetryczną, a także rola funkcji skrótu.

Kryptografia symetryczna vs asymetryczna – kluczowa różnica

W ujęciu praktycznym można przyjąć prosty podział:

- Kryptografia symetryczna – ten sam klucz do szyfrowania i deszyfrowania (AES, ChaCha20).

- Kryptografia asymetryczna – inny klucz publiczny do szyfrowania/weryfikacji i prywatny do deszyfrowania/podpisu (RSA, ECC, Diffie‑Hellman).

Przykładowe algorytmy i zastosowania

Najczęściej używane elementy:

Najczęstsze klocki w praktycznych protokołach

Jeśli spojrzysz na typowe połączenie HTTPS, VPN czy komunikator E2E, zobaczysz powtarzający się schemat składania „klocków” kryptograficznych:

- asymetryka – do ustalenia wspólnego sekretu lub weryfikacji tożsamości (RSA, ECDH, ECDSA),

- symetryka – do szyfrowania dużej ilości danych po ustaleniu klucza (AES‑GCM, ChaCha20‑Poly1305),

- funkcje skrótu / KDF – do mieszania sekretów, tworzenia kluczy sesyjnych, podpisów (SHA‑2, SHA‑3, HKDF).

Zastanów się: który z tych elementów jest w twoim systemie „wszędzie”, a który pojawia się tylko na początku sesji?

Odpowiedź jest zwykle oczywista: symetryka i skróty „mielą” dane non stop, a asymetryka pojawia się w newralgicznych momentach – przy starcie połączenia, walidacji certyfikatu, wymianie kluczy.

Co dokładnie złamie Shor, a co tylko osłabi Grover?

Teraz najważniejsze pytanie: które z tych elementów dostają bezpośrednio „po głowie” od komputerów kwantowych?

Algorytmy oparte na faktoryzacji i logarytmie dyskretnym – w czerwonej strefie

Do tej grupy należą wszystkie mechanizmy, których bezpieczeństwo opiera się na tym, że trudno odwrócić pewną operację matematyczną:

- RSA – trudność rozkładu dużej liczby na czynniki pierwsze,

- klasyczny Diffie‑Hellman nad liczbami pierwszymi,

- ECC (krzywe eliptyczne: ECDSA, ECDH, EdDSA) – problem logarytmu dyskretnego na krzywych eliptycznych.

Dla tych konstrukcji algorytm Shora daje wielomianowy czas działania. Tłumacząc na praktykę: przy wystarczająco dużym komputerze kwantowym, RSA‑2048 czy popularne krzywe eliptyczne można złamać w rozsądnym czasie. Nie trzeba już milionów lat klasycznego bruteforce’u.

Jeśli używasz dziś:

- HTTPS z certyfikatami RSA/ECDSA,

- VPN (IPsec, OpenVPN, WireGuard) z ECDH/ECDSA,

- SSH z RSA lub ECDSA,

- podpisów kodu (np. aktualizacje oprogramowania) na RSA/ECC,

– to właśnie te elementy będą wymagały najgłębszej przebudowy. Dane podsłuchane dziś (np. ruch HTTPS) mogą zostać odszyfrowane w przyszłości, jeśli przeciwnik nagra ruch i później złamie klucze serwera.

Zadaj sobie krótkie pytanie: czy ktoś może nagrywać mój ruch sieciowy dzisiaj, licząc, że za 10–20 lat go odszyfruje?

Kryptografia symetryczna i funkcje skrótu – „tylko” grubsze klucze

Algorytmy symetryczne (AES, ChaCha20) i funkcje skrótu (SHA‑2, SHA‑3) nie mają znanego odpowiednika algorytmu Shora, który dawałby dramatyczne przyspieszenie. Pojawia się tu natomiast Grover, który przyspiesza przeszukiwanie „czarnej skrzynki” (np. kluczy) z 2n do około 2n/2 kroków.

Jak przekłada się to na praktykę?

- AES‑128 z perspektywy „świata kwantowego” oferuje mniej więcej 64 bity efektywnego bezpieczeństwa przy idealnym Groverze,

- AES‑256 spada do poziomu około 128 bitów efektywnego bezpieczeństwa, co nadal jest ogromnym zapasem,

- funkcje skrótu o długości 256 bitów (SHA‑256) również stają się „jakby 128‑bitowe” przy idealnym kwantowym ataku brute‑force.

Dlaczego więc nie ma paniki wokół AES?

Po pierwsze, kwadratowe przyspieszenie to zupełnie inny rząd niż „wykładnik na wielomian” w Shorze. Po drugie, atak Grovera wymaga ogromnej liczby spójnych operacji kwantowych i realne koszty sprzętowe są trudne do przewidzenia – to nie jest „za darmo”.

Prosta wskazówka: jeśli dziś projektujesz nowy system, ustaw AES‑256 + SHA‑256/384 i śpisz spokojnie. Jeżeli siedzisz na AES‑128 – nie ma potrzeby natychmiastowej paniki, ale przy poważnych migacjach (np. duży redesign protokołu) warto rozważyć „podkręcenie” parametrów.

Podpisy cyfrowe i PKI – pięta achillesowa długoterminowej poufności

Podpisy cyfrowe (certyfikaty TLS, podpisy kodu, podpisy dokumentów) to szczególnie wrażliwy element. Dlaczego?

- Gdy napastnik złamie klucz prywatny CA lub serwera, może podszywać się pod przeszłe aktualizacje oprogramowania albo generować fałszywe certyfikaty,

- część dokumentów podpisanych dziś musi zachować ważność prawno‑dowodową przez kilkanaście lub kilkadziesiąt lat.

Zastanów się: czy twoja organizacja przechowuje ważne prawnie dokumenty elektroniczne z podpisami kwalifikowanymi lub firmowymi? Jak długo mają one być uznawane za „niepodważalne”?

Jeśli odpowiedź to „10+ lat”, temat post‑quantum signatures przestaje być eksperymentem, a zaczyna być wymaganiem projektowym.

Które scenariusze są realnie zagrożone dzisiaj?

Dla kwantowego atakującego szczególnie kuszące są dwa modele działań: store now, decrypt later oraz forgery w długim horyzoncie.

Store now, decrypt later – nagrywanie ruchu na przyszłość

Wyobraź sobie, że ktoś ma dostęp do głównych punktów wymiany ruchu w sieci albo do infrastruktury telekomunikacyjnej. Może on:

- nagrywać zaszyfrowany ruch HTTPS, VPN, e‑mail,

- przechowywać te dane w archiwach taśmowych lub chmurze,

- za 10–20 lat wykorzystać do ich odszyfrowania wydajny komputer kwantowy łamiący RSA/ECC.

Kto działa w takim modelu? Zwykle państwa, służby wywiadowcze, bardzo duże organizacje przestępcze. Wymaga to ogromnych zasobów, ale jeśli twoje dane są z ich perspektywy strategiczne (wojsko, krytyczna infrastruktura, R&D, opozycja w reżimie autorytarnym), zapis ruchu „na później” jest sensowną inwestycją.

Pomyśl: czy w twoim świecie istnieje ktoś, dla kogo twoja komunikacja z dziś będzie cenna w perspektywie dekady?

Fałszowanie podpisów i certyfikatów w przeszłości

Drugi scenariusz to podważanie historii:

- fałszywe „archiwalne” aktualizacje oprogramowania,

- podpisane dokumenty prawne, które rzekomo pochodzą z przeszłości,

- fałszywe logi i audyty „udowadniające”, że coś zostało zrobione lub nie.

Dzisiaj wiele procesów compliance i dowodów sądowych opiera się na założeniu, że podpisy RSA/ECC są niepodrabialne. Gdy te algorytmy upadną, bez dodatkowych zabezpieczeń czasowych i łańcuchów zaufania część archiwalnych danych cyfrowych stanie się problematyczna dowodowo.

Jak możesz się bronić? Jedna ze strategii to:

- dodatkowe znaczniki czasu (np. RFC 3161, blockchainy prywatne/publiczne),

- przedłużanie ważności podpisów z użyciem mocniejszych algorytmów i zewnętrznych dowodów istnienia (archiwa, notariusze cyfrowi).

Jeśli twoja organizacja buduje system archiwizacji dowodów, logów, dokumentów na dekady – gdzie zapisujesz informację, kiedy dokładnie coś zostało podpisane i jakim algorytmem?

Kluczowe algorytmy kwantowe przeciwko szyfrowaniu: Shor i Grover

Skoro wiadomo już, które klasy szyfrów są najbardziej zagrożone, warto przyjrzeć się dwóm głównym „narzędziom zbrodni”. Niekoniecznie z pełnymi wzorami, ale z praktyczną intuicją: co musiałby mieć napastnik, żeby użyć ich przeciwko twoim systemom?

Algorytm Shora – młot na RSA i ECC

Algorytm Shora rozwiązuje dwa kluczowe problemy:

- faktoryzacja dużych liczb (używana w RSA),

- logarytm dyskretny w różnych grupach (klasyczny DH i krzywe eliptyczne).

Wspólnym mianownikiem jest sprowadzenie zadania do problemu okresowości pewnej funkcji. I tu wchodzi kwantowa magia: przekształcenie Fouriera na stanach kwantowych (QFT), które pozwala znaleźć okres funkcji w czasie wielomianowym.

Co to oznacza dla rozmiaru klucza?

W świecie klasycznym zwiększasz rozmiar klucza RSA (np. z 2048 do 4096 bitów) i dramatycznie rośnie koszt ataku. W świecie z wydajnym Shorem, zwiększanie rozmiaru klucza tylko liniowo zwiększa trudność – co zupełnie niszczy podstawowy mechanizm obrony.

Przykładowo, dla RSA‑2048 istnieją szacunki, że potrzeba byłoby rzędu kilku tysięcy logicznych qubitów i bardzo dużej liczby operacji – ale to tylko część historii. Potrzebne są jeszcze korekcja błędów, nadmiarowe qubity fizyczne i stabilna architektura sprzętowa.

Kluczowe pytanie: czy napastnik będzie miał przez kilka godzin/dni dostęp do wystarczająco dużego, skorygowanego błędowo komputera kwantowego? Jeśli tak – RSA/ECC tracą sens jako długoterminowe fundamenty bezpieczeństwa.

Dlaczego obecne demonstracje Shora „na kilku qubitach” niczego nie zmieniają?

Regularnie pojawiają się nagłówki typu „Złamano RSA na komputerze kwantowym!”. Gdy spojrzeć w szczegóły, zwykle chodzi o:

- liczby bardzo małe (np. kilkudziesięciobitowe),

- ręcznie dobrane przypadki,

- eksperymentalne implementacje bez pełnej korekcji błędów.

Co z tego wynika dla twoich decyzji dziś?

- nie ma powodu, żeby w panice wyłączać HTTPS i VPN,

- jest powód, żeby projektować nowe systemy z możliwością wymiany RSA/ECC na post‑quantum bez przebudowy całej aplikacji,

- warto mieć świadomość, że bariera jest inżynierska, nie teoretyczna – algorytm istnieje i działa, tylko sprzęt jeszcze „nie dowozi” odpowiedniej skali.

Jaki masz dziś plan aktualizacji swoich protokołów, gdy tylko standardy post‑quantum zostaną szerzej wdrożone w TLS, SSH czy VPN?

Algorytm Grovera – turbo‑bruteforce na kluczach symetrycznych

Grover to algorytm służący do przyspieszania przeszukiwania nieuporządkowanej przestrzeni. W kontekście kryptografii możesz myśleć o nim jako o ogólnym przyspieszaczu brute‑force na kluczach lub pre‑image’ach funkcji skrótu.

Jak działa w uproszczeniu?

W klasycznym brute‑force próbujesz kolejne klucze i sprawdzasz, czy dany wynik pasuje. Średnio po 2n‑1 próbach trafiasz. Grover ustawia superpozycję wszystkich możliwych kluczy, stosuje operator „orakla”, który zaznacza poprawne odpowiedzi, a następnie sekwencję operacji wzmacniających amplitudę poprawnego klucza kosztem pozostałych.

Po około O(2n/2) iteracjach pomiar daje wysoki (choć nie 100%) szansę na trafienie poprawnego klucza. To ogromne przyspieszenie matematyczne, ale wciąż nie zmienia natury problemu na „łatwy”. Dla 256‑bitowego klucza nawet 2128 jest poza rozsądnym zasięgiem w przewidywalnej przyszłości.

Co powinien zrobić projektant protokołów?

Jeśli odpowiadasz za dobór parametrów kryptograficznych, możesz przyjąć prostą zasadę:

- dla kluczy symetrycznych – traktuj n‑bitowy klucz jakby miał n/2 bitów bezpieczeństwa,

- celuj w docelowe bezpieczeństwo rzędu 128 bitów, co sugeruje 256‑bitowe klucze symetryczne.

W praktyce oznacza to:

- AES‑256 zamiast AES‑128 w nowych systemach,

- SHA‑256 (lub SHA‑384) jako baseline,

- przemyślane długości kluczy w HMAC, KDF itd.

Kiedy komputery kwantowe staną się realnym zagrożeniem – scenariusze czasowe

Teoretycznie wiemy, że Shor „zjada” RSA/ECC, a Grover ścina bezpieczeństwo kluczy symetrycznych o połowę. Pytanie operacyjne brzmi: kiedy te zagrożenia zaczną działać w twoim kalendarzu projektowym, a nie tylko w abstrakcyjnych wykresach?

Zamiast jednej daty końca świata sensowniej myśleć o scenariuszach dojrzewania technologii. Każdy z nich ma inne konsekwencje dla tego, co robisz dzisiaj z infrastrukturą i protokołami.

Trzy poziomy dojrzałości komputerów kwantowych

Spróbuj na chwilę ustawić się w roli atakującego. Jakiej klasy sprzętu potrzebujesz?

- Poziom 1 – demonstratory i prototypy NISQ (Noisy Intermediate-Scale Quantum): setki–tysiące fizycznych qubitów, bez pełnej korekcji błędów. Dobre do badań, bezużyteczne do łamania realnego RSA‑2048.

- Poziom 2 – wyspecjalizowane maszyny do łamania wybranych kluczy: tysiące–dziesiątki tysięcy logicznych qubitów, działających stabilnie przez godziny/dni. Tu pojawia się realna możliwość złamania pojedynczych, celowanych kluczy RSA/ECC.

- Poziom 3 – „użytkowe” kwantowe centra danych: infrastruktura pozwalająca na równoległe uruchamianie wielu instancji Shora/Grovera, automatyzowana, dostępna stałym zespołom operatorów – coś w rodzaju dzisiejszych farm GPU dla ML.

Na którym poziomie spodziewasz się, że twoje systemy zaczną być krytycznie narażone? Dla większości organizacji granicą jest wejście w Poziom 2, czyli moment, gdy pojawia się możliwość złamania konkretnych długoterminowych kluczy.

Co mówią dzisiejsze prognozy – i jak do nich podchodzić

Modele rozwoju sprzętu kwantowego są obarczone dużą niepewnością. Różne zespoły badawcze i agencje rządowe publikują oszacowania typu „10–30 lat do złamania RSA‑2048”. W praktyce bardziej użyteczne są widełki scenariuszowe niż konkretne daty.

Przykładowy podział może wyglądać tak:

- Scenariusz agresywny: pierwsze wyspecjalizowane maszyny zdolne do złamania pojedynczych kluczy RSA‑2048 pojawiają się w okolicach 10 lat, dostępne wąskiej grupie państw/korporacji.

- Scenariusz umiarkowany: realne zagrożenie dla RSA‑2048/EC‑256 w horyzoncie 20–25 lat.

- Scenariusz opóźniony: przełomy w korekcji błędów i skalowaniu wypalają się wolniej, realne ataki dopiero za 30+ lat.

Jak to wykorzystać? Najpierw ustal, jaki jest horyzont poufności twoich danych i decyzji podpisanych cyfrowo. Dopiero potem przyporządkuj się do scenariusza.

Horyzont poufności vs. horyzont ataku

Kluczowe pojęcie, które porządkuje decyzje, to „horyzont poufności” (ang. security lifetime). Jak długo dana informacja musi pozostać niejawna, żeby nie zrobić ci krzywdy?

Weź kilka typowych kategorii:

- Ruch webowy B2C (logowanie do sklepu, odczyt prasy): horyzont poufności najczęściej poniżej 5 lat.

- Dane medyczne, dokumentacja HR: często 20+ lat poufności, czasem przez całe życie pacjenta/pracownika.

- Strategie biznesowe, tajemnice technologiczne: w R&D czy obronności bywa, że liczą się nawet po 30 latach.

- Dokumenty prawne i podpisy kwalifikowane: wymogi retencji i ważności dowodowej często sięgają kilkudziesięciu lat.

Zderz to z potencjalnym horyzontem ataku kwantowego. Jeżeli szacujesz, że:

- realne łamanie RSA‑2048 nastąpi za 20 lat (umiarkowany scenariusz),

- a twoje dane muszą być tajne przez 25 lat,

to obecne szyfrowanie RSA/ECC nie dowozi bezpieczeństwa przez pełen wymagany okres. Wchodzisz w strefę, gdzie „store now, decrypt later” jest realnym ryzykiem. Jeśli zaś masz dane wrażliwe przez 3 lata, ten sam scenariusz jest dużo mniej groźny.

Jakie dane w twojej organizacji mają najdłuższy, udokumentowany horyzont poufności? Czy jest on spisany, czy tylko „wszyscy wiedzą, że długo”?

Scenariusz 1: powolna ewolucja – 25+ lat do realnych ataków

W tym wariancie rozwój sprzętu kwantowego idzie wolniej niż oczekują optymiści. Uzyskanie tysięcy logicznych qubitów z sensowną korekcją błędów trwa dekady. Ataki na RSA‑2048 pozostają teoretyczne przez długi czas.

Co to oznacza w praktyce?

- większość typowych systemów biznesowych (web, mobilne, VPN-y pracownicze) można migrować przy okazji większych rewizji architektury, bez nerwowych ruchów,

- instytucje odpowiedzialne za dane o horyzoncie 20–30 lat (rządy, sektor zdrowia, obrona, banki depozytowe) i tak muszą zacząć migrację wcześniej, bo sam proces wymiany fundamentów kryptograficznych trwa latami,

- możesz pozwolić sobie na etapowe podejście: pilotaże PQC, hybrydowe protokoły, stopniowe wymiany bibliotek i urządzeń HSM.

Jeśli twój świat to głównie „typowe systemy biznesowe”, tu największym ryzykiem staje się nie tyle sam kwant, co technologiczny dług – systemy, które będą działać jeszcze za 15–20 lat, a których nikt dziś nie projektuje z myślą o łatwej wymianie kryptografii.

Jakie systemy w twojej organizacji są „zbyt drogie, żeby je kiedyś przepisać od zera”? To najpoważniejsi kandydaci do wczesnego przygotowania pod PQC.

Scenariusz 2: umiarkowane tempo – 15–25 lat do złamania RSA‑2048

To scenariusz, który przyjmuje wiele konserwatywnych analiz rządowych. Zakłada, że rozwój jest trudny, ale postępuje: pojawiają się przełomy w korekcji błędów, poprawa jakości qubitów, lepsze architektury sprzętowe.

Konsekwencje dla architektów i CISO są bardziej jednoznaczne:

- wszystkie nowe systemy z horyzontem życia powyżej 10 lat muszą być quantum‑ready,

- kluczowe systemy o długiej retencji danych (archiwa, e‑zdrowie, rejestry państwowe) powinny mieć zaplanowaną migrację na PQC w ciągu kilku najbliższych lat,

- przestaje być akceptowalne, że warstwa kryptograficzna jest ciasno zabetonowana w kodzie aplikacji.

W tym scenariuszu jest spore prawdopodobieństwo, że:

- twoje dzisiejsze dane strategiczne ktoś już nagrywa,

- twoje dzisiejsze systemy będą jeszcze działały, gdy Shor stanie się praktyczny dla dużych kluczy.

Pojawia się naturalne pytanie: kiedy zacząć? Rozsądnym punktem odniesienia jest kalendarz standaryzacji PQC (NIST, ETSI, IETF). Gdy produkcyjne wersje algorytmów i protokołów są dostępne, zegar migracji zaczyna tykać.

Czy twoja organizacja ma mapę systemów z zaznaczonym: horyzontem życia, horyzontem poufności danych i aktualnym zestawem algorytmów? Bez tego trudno przyporządkować się do sensownego harmonogramu.

Scenariusz 3: przyspieszenie i „czarny łabędź” – 10 lat lub mniej

Tu zakładamy, że następuje nieoczekiwany przełom: nowa architektura qubitów, radykalna poprawa korekcji błędów, albo protokół hybrydowy, który znacząco obniża wymagania sprzętowe Shora. Dla bezpieczeństwa ten scenariusz trzeba uwzględnić, nawet jeśli wydaje się mało prawdopodobny.

W takim wariancie:

- horyzont poufności 10+ lat staje się krytyczny już dziś,

- instytucje wysokiego ryzyka (wywiad, obronność, opozycja w krajach autorytarnych, część korporacji high‑tech) powinny traktować obecne połączenia RSA/ECC jak potencjalnie nagrywane do późniejszego odszyfrowania,

- pojawia się sens wdrażania hybryd PQC nawet kosztem podniesionej złożoności operacyjnej.

Jak reagować na scenariusze „czarnego łabędzia”? Dobrą praktyką jest planowanie w dwóch warstwach:

- warstwa bazowa – migracja zgodna z głównymi standardami i konserwatywnymi założeniami,

- warstwa awaryjna – mechanizm szybkiego „przepięcia” krytycznych systemów na agresywniejsze ustawienia (np. narzucone centralnie polityki kryptograficzne, możliwość wymuszenia PQC/hybryd na bramkach bezpieczeństwa).

Mówiąc prościej: czy masz w ogóle techniczny przycisk, którym da się w rozsądnym czasie zmienić zestaw algorytmów używany w TLS, VPN, S/MIME czy w wewnętrznym PKI? Jeśli nie, scenariusz przyspieszony jest dla ciebie dużo bardziej bolesny.

Mapowanie ryzyka kwantowego na typy organizacji

Nie każdy powinien reagować tak samo. Zamiast ogólnego strachu przyda się prosta samodiagnoza: do której z poniższych grup jesteś najbliżej?

- Grupa A – wysokie ryzyko strategiczne: rządy, wojsko, wywiad, krytyczna infrastruktura, duże instytucje finansowe, globalne firmy technologiczne, podmioty wrażliwe politycznie. Horyzont poufności danych zazwyczaj przekracza 20 lat, a motywacja wyspecjalizowanych atakujących jest wysoka.

- Grupa B – średnie ryzyko, długi horyzont retencji: sektor zdrowia, ubezpieczenia, część sektora publicznego, archiwa danych (np. rejestry nieruchomości, sądy), uczelnie przechowujące wyniki badań i dane osobowe absolwentów.

- Grupa C – typowy biznes komercyjny: e‑commerce, SaaS, produkcja, usługi B2B, większość MŚP, których dane tracą wartość szybciej, a zainteresowanie przez państwowych aktorów jest niewielkie.

Jak odróżnić te grupy w praktyce?

- Jeśli najważniejsze dane w twojej organizacji nadal są krytyczne po 20–30 latach – jesteś bliżej Grupy A/B.

- Jeśli po 5 latach większość things‑to‑hide jest już mało istotna – bliżej ci do Grupy C.

W jakiej grupie umieściłbyś swoją organizację patrząc na dane, nie na marketing? Ten wybór powinien sterować tempem twoich działań.

Orientacyjne oś czasu dla standardów i migracji

Nawet gdyby jutro ogłoszono praktyczne złamanie RSA‑2048, infrastruktura kryptograficzna nie zmieni się z dnia na dzień. W realnym świecie każda warstwa ma swoje tempo:

- standardy algorytmów (NIST PQC, ETSI, IETF) – kilka lat między pierwszymi propozycjami a stabilnymi specyfikacjami;

- implementacje bibliotek (OpenSSL, BoringSSL, wolfSSL, biblioteki w językach wysokiego poziomu) – kolejne lata na dojrzewanie, testy interoperacyjności i usuwanie błędów;

- wdrożenia w produktach (przeglądarki, serwery, HSM, urządzenia sieciowe) – zależne od cyklu wydawniczego dostawców;

- faktyczna migracja organizacji – od wymiany certyfikatów i protokołów po aktualizację sprzętu w data center i na brzegu sieci.

Łącznie mówimy o co najmniej kilku–kilkunastu latach, nawet przy dużej mobilizacji. To oznacza, że czekanie „aż wszystko będzie gotowe” jest strategią ryzykowną, zwłaszcza dla Grup A i B.

W której z tych warstw masz dzisiaj największy wpływ? Na standardy raczej nie, ale na wybór bibliotek, produktów i architektury – jak najbardziej.

Techniczna gotowość: gdzie teraz realnie jesteśmy?

Obraz „zagrożenia kwantowego” mocno zależy od tego, czy patrzysz na komunikaty prasowe, czy na twarde parametry sprzętu i korekcji błędów. Dobrze jest mieć choć zgrubny obraz aktualnego stanu.

Na dziś:

- publicznie dostępne komputery kwantowe (chmury kwantowe dużych dostawców) działają na poziomie setek–tysięcy fizycznych qubitów, ale z dużym szumem,

- pełna korekcja błędów dla dużych obliczeń jest wciąż poza praktycznym zasięgiem, liczba potrzebnych qubitów fizycznych na jeden qubit logiczny idzie w tysiące lub dziesiątki tysięcy,

Najczęściej zadawane pytania (FAQ)

Kiedy komputery kwantowe realnie zagrożą szyfrowaniu typu RSA i ECC?

Kluczowy moment to pojawienie się stabilnych komputerów kwantowych z milionami kubitów fizycznych, z których da się zbudować wystarczająco dużo tzw. kubitów logicznych (z korekcją błędów). Dopiero wtedy algorytm Shora będzie mógł praktycznie łamać obecne standardy, takie jak RSA 2048 czy krzywe eliptyczne (ECC‑256).

Prognozy są rozstrzelone, ale wiele analiz mówi o horyzoncie rzędu 10–20 lat dla realnego zagrożenia dla powszechnie używanych kluczy. Masz wrażliwe dane, które muszą być tajne dłużej niż dekadę? Wtedy mówimy już o ryzyku, z którym trzeba się liczyć na etapie planowania, a nie „kiedyś, później”.

Co oznacza „store now, decrypt later” i czy naprawdę powinienem się tym przejmować?

„Store now, decrypt later” to strategia ataku, w której napastnik przechwytuje zaszyfrowany ruch dziś (np. HTTPS, VPN, SSH), a odszyfrowuje go dopiero wtedy, gdy będzie dysponował odpowiednio silnym komputerem kwantowym. Kluczowe pytanie brzmi: jak długo te przechwycone dane mają pozostać poufne?

Jeśli twoje dane „starzeją się” szybko (np. tymczasowe zlecenia, krótkie kampanie marketingowe), ryzyko jest niższe. Ale jeśli przechowujesz dokumentację medyczną, umowy na dekady, dane wywiadowcze czy modele ryzyka w banku – przechwycony dziś ruch może być bardzo cenny nawet za 10–20 lat. Zastanów się: które twoje dane są wrażliwe również w długim horyzoncie?

Jak ocenić, czy moja firma powinna już planować migrację do kryptografii post‑kwantowej?

Punkt wyjścia jest prosty: na ile lat chcesz zachować poufność konkretnych klas danych? Zrób krótką listę: dane transakcyjne, umowy, dokumentacja medyczna, tajemnice handlowe, dane klientów. Przy każdej pozycji dopisz orientacyjny okres poufności – 5, 10, 30 lat?

Jeśli choć jedna ważna kategoria danych ma horyzont bezpieczeństwa powyżej 10 lat, warto:

- zidentyfikować używane dziś algorytmy (RSA, ECC, długości kluczy, stare protokoły),

- projektować nowe systemy z myślą o łatwej wymianie kryptografii (crypto‑agility),

- śledzić standardy NIST/IETF dotyczące algorytmów post‑kwantowych i uwzględniać je w roadmapach.

Zadaj sobie pytanie: jeśli za 10 lat pojawią się wymagania regulacyjne „musisz być post‑kwantowy w 2 lata” – czy twoja obecna architektura to udźwignie bez bólu?

Czy mały biznes lub software house musi się już martwić komputerami kwantowymi?

Mały blog czy prosta strona wizytówkowa faktycznie nie musi dziś inwestować w post‑kwantową kryptografię. Natomiast mały software house projektujący systemy SaaS z danymi osobowymi klientów – już tak. Tu nie chodzi o panikę, tylko o mądrą architekturę.

Jeśli tworzysz system, który:

- będzie działał ponad 5–10 lat,

- przetwarza dane, które klienci muszą chronić „na dekady”,

- podlega regulacjom (finanse, medycyna, sektor publiczny),

to opłaca się od razu zadbać o crypto‑agility: warstwę kryptografii odseparowaną od logiki biznesowej, konfigurację algorytmów „z pliku”, możliwość rotacji i wydłużania kluczy. Pytanie do ciebie: jeśli za kilka lat klient poprosi o „podmianę całej kryptografii na post‑kwantową”, ile to dziś kosztowałoby w twoim systemie?

Jakie branże są najbardziej narażone na kwantowe łamanie szyfrów?

Na pierwszej linii są podmioty, które gromadzą dane długoterminowe i są naturalnym celem państw lub dużych organizacji:

- administracja publiczna – rejestry obywateli, dane medyczne, podatkowe, materiały wywiadowcze,

- banki i instytucje finansowe – dane transakcyjne, kanały bankowości elektronicznej, długoterminowe podpisy cyfrowe,

- duże korporacje technologiczne – własność intelektualna, tajemnice handlowe, dane klientów B2B na lata.

W drugiej kolejności są mniejsze firmy, które budują rozwiązania dla powyższych sektorów (software house’y, integratorzy). Nawet jeśli twoja firma nie dotrwa 20 lat, systemy i dane klientów mogą żyć dużo dłużej. Warto zadać sobie pytanie: czy moi klienci mają dane długowieczne, które ktoś mógłby archiwizować już dziś?

Czy jako zwykły użytkownik internetu powinienem bać się komputerów kwantowych?

Dla większości prywatnych użytkowników ryzyko jest pośrednie i odłożone w czasie. Większość codziennych danych (zakupy online, logowania do serwisów, zwykłe rozmowy) traci wrażliwość względnie szybko – po kilku latach mało kto będzie chciał je odszyfrowywać.

Inaczej wygląda sytuacja, gdy:

- prowadzić działalność polityczną lub aktywistyczną w kraju autorytarnym,

- przechowujesz materiały, które mogą być kompromitujące również za wiele lat,

- komunikujesz się z osobami szczególnie narażonymi (dziennikarze, prawnicy, opozycja).

W takich scenariuszach warto już dziś stosować dobre praktyki: aktualne protokoły szyfrowania, silne hasła, menedżery haseł, ostrożność przy wyborze komunikatorów. Zastanów się: kto realnie mógłby chcieć wrócić do twoich dzisiejszych danych za 10–15 lat?

Czym różni się komputer kwantowy od klasycznego w kontekście łamania szyfrów?

Klasyczny komputer operuje na bitach: 0 lub 1. Komputer kwantowy używa kubitów, które mogą być w superpozycji – czymś w rodzaju „0 i 1 naraz”, dopóki ich nie zmierzysz. Do tego dochodzą splątanie i interferencja, dzięki którym można tak „ustawić” obliczenia, aby poprawne odpowiedzi miały wyższe prawdopodobieństwo pojawienia się przy pomiarze.

Dobrze skonstruowany algorytm kwantowy (jak Shora do faktoryzacji czy Grovera do przeszukiwania) potrafi dramatycznie przyspieszyć konkretne zadania matematyczne, na których opiera się dzisiejsze szyfrowanie asymetryczne. Nie przyspiesza wszystkiego, ale uderza dokładnie w fundamenty RSA i częściowo ECC. Pytanie do ciebie: które mechanizmy w twoich systemach polegają na RSA/ECC, a które na samych funkcjach skrótu lub szyfrach symetrycznych?

Co warto zapamiętać

- Kluczowe pytanie brzmi: na ile lat twoje dane muszą pozostać poufne? Jeśli choć jedna ważna kategoria przekracza 10 lat (np. medyczne, finansowe, wywiadowcze), zagrożenie ze strony komputerów kwantowych trzeba uwzględnić już teraz.

- Odkładanie tematu „na 2040+” oznacza rezygnację z kilku ważnych decyzji: przeglądu używanych algorytmów (RSA, ECC, długości kluczy), planu migracji do kryptografii post‑kwantowej oraz projektowania systemów z łatwą wymianą mechanizmów szyfrowania (crypto‑agility).

- Ataki typu „store now, decrypt later” są realnym scenariuszem: ktoś może dziś przechwytywać zaszyfrowany ruch (TLS, VPN, bankowość) i odszyfrować go za 10–15 lat. Zadaj sobie pytanie: czy twoje dzisiejsze dane będą wtedy nadal wrażliwe?

- Prawdziwe ryzyko nie wynika z pojedynczych rekordów „quantum supremacy”, lecz z momentu, gdy pojawią się duże, skorygowane błędami komputery kwantowe, potrafiące praktycznie uruchamiać algorytmy Shora i Grovera oraz dostępne w modelu „quantum‑as‑a‑service”.

- Różne podmioty mają różny horyzont myślenia: administracja i sektor finansowy muszą planować w skali dekad, software house’y – projektować systemy z myślą o przyszłej wymianie kryptografii, a użytkownik prywatny powinien ocenić, czy ktoś może wrócić do jego danych za wiele lat.